起底新型杀猪盘:这项AI技术竟成“屠宰”工具

近日,央视八套公安题材热播剧《警察荣誉》拿下电视剧“后黄金时段”收视第一,并获中纪委点赞。在该剧6月12日播出的35集中,一起直接导致受害人轻生的“杀猪盘”诈骗案,使得这一残忍的诈骗形式再度引发网友在微博上的热议。

据腾讯发布的《2021年电信网络诈骗治理研究报告》显示:从案发量来看,“杀猪盘”以18.9%的占比位列诈骗类型第二;从总体损失金额来看,“杀猪盘”达到所有电信网络诈骗的40.2%,案均损失金额也高达17.07万元,远远高于其它诈骗类型的案均损失金额。据公安部数据,仅2019年1-8月,“杀猪盘”就已造成群众损失38.8亿元。

殊不知,一种新型“杀猪盘”已悄然兴起,它与深度伪造技术(又称“AI换脸”)魔鬼联姻,手段升级,欺骗性、迷惑性更强。

老骗术惊现新“杀”技

就在前不久,法国电影制片人伊扎贝尔·齐斯基(Yzabel Dzisky)向BBC讲述了自己所遭遇的“杀猪盘”骗局。

46岁的伊扎贝尔通过约会APP认识了一位土耳其的著名外科医生“穆拉特”,此后便坠入爱河,两人频繁网聊,偶尔视频通话。之后,她也在谷歌上搜到了大量关于“穆拉特”本人的信息以及照片。热聊一段时间后,伊扎贝尔得到了“穆拉特”不久就会来看她的承诺,但他必须要先到上海出差。

伊扎贝尔说,“穆拉特”在上海时给她打电话称自己要买医疗设备,但信用卡在上海没法用,让她给他寄3000欧元过去,然后他就可以飞到巴黎与伊扎贝尔见面了。尽管对“外科医生还需借钱”感到怀疑,但伊扎贝尔还是决定通过国际汇款给他汇去200欧元。

3天后,伊扎贝尔在机场等了再等,然而,“穆拉特”却根本没有出现。于是,“交友诈骗”这样的词汇开始伊扎贝尔脑海中浮现,但她又觉得不可能,毕竟自己在视频中见过他。

几天后,“穆拉特”主动联系了伊扎贝尔。但这次,伊扎贝尔想在大屏幕上看到他,于是通过电脑连了线。但此次发现视频效果非常差,有明显地视觉滞后现象,在穆拉特讲话时还有“咔咔的点击声”。伊扎贝尔想听听专家的看法,一位视频编辑告诉她到YouTube上看一下深度伪造(“Deepfake”)视频就明白了。

法国电影制片人伊扎贝尔·齐斯基(Yzabel Dzisky)

法国电影制片人伊扎贝尔·齐斯基(Yzabel Dzisky)

她终于接受自己被骗的事实,并设法说服“穆拉特”再跟她视频时质问对方:“我知道你不是穆拉特,你到底是谁?”对方告诉她,自己叫大卫,其实是一名20岁的尼日利亚黑客,他们有一个庞大的诈骗网络,已骗取了很多钱,通过这些假帐户他已经致富了。

如果说,此前的“假靳东”视频骗局,是利用了中老年妇女的信息鸿沟。那么,像伊扎贝尔这样的高知女性所经历的深度伪造技术加持骗局,如果真的遭遇,你究竟能有几成把握幸免?不可否认,这一老骗术,因AI技术的加持,迸发了新生机。

曾经围猎爱情,如今收割友情、亲情

有人会说,自己从不在网络上寻找爱情,因此“杀猪匠”们就没有可乘之机。然而,这些“屠夫”早就不满足于围猎爱情了,友情、亲情也无法逃脱。

2月15日,浙江温州的陈先生收到了身在国外的好友“阿诚”发来的私信,要求加他的新 微信 号,因为昔日的友情,陈先生果断添加了对方微信。在简单寒暄过后,“阿诚”称自己购买回国机票的过程中遇到了难题,希望陈先生帮忙联系经理进行付余款。然后他将钱转给陈先生。

因为涉及钱,陈先生对于此人的身份还有所怀疑,对方见陈先生迟迟没有回消息,“阿诚”随后打来视频电话。此时,陈先生渐渐打消了心中的顾虑。随后,“阿诚”发来转账截图,称已将钱转进陈先生的银行卡,24小时内就能到账。深信不疑的陈先生在“阿诚”一步步“指导”下,添加了“航空公司经理”的微信,替“阿诚”支付了49200元。

结果当天晚上,陈先生刷到“阿诚”的“旧”微信,与其聊起了白天转账的事情,这才知道自己被骗了。随后,陈先生便到浙江省温州市公安局瓯海分局仙岩派出所报案。经过警方核实,这也是一起利用“AI换脸”技术进行诈骗的案件。

在近期的热播剧《猎罪图鉴》中,嫌疑人则利用“AI换脸”技术摇身一变成为空巢老人的子女,以“爱”之名实施诈骗。“儿子”声称缺钱问老人频频要钱,老人多次汇款以后发现不对劲才知道上当了,而这时已经把全部积蓄都给了骗子。

识破AI骗局,要靠“魔法打败魔法”

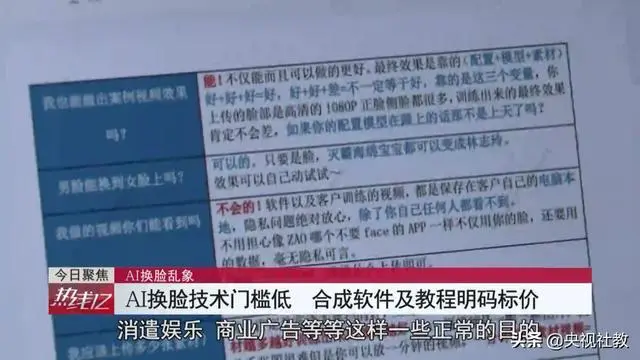

今年2月发布的《深度合成十大趋势报告(2022)》指出,随着深度合成技术的开放开源、深度合成产品和服务的增多,深度合成内容制作的技术门槛越来越低。报告发布方瑞莱智慧RealAI副总裁唐家渝介绍,由于很多代表性的生成方法已经被开源,技术走向公开和轻量化,甚至已有黑产分子售卖深度伪造软件及教程,让普通人从零开始几分钟就能生成一段用于App身份核验的深度伪造视频。

技术的“平民化”,使得利用“AI换脸”“AI换声”等虚假音视频,进行诈骗、勒索、诬陷、诽谤等违法行为和事例屡见不鲜。更为严峻的是,随着AI技术的快速发展,深伪视频的动作逼真度、自然度,以及视频整体的清晰度、流畅度都得到大幅提升,肉眼已很难识别真假。

怎么办?只有魔法才能打败魔法。

“学术界和产业界目前均已对深度伪造鉴别检测技术研发进行了大量投入,Meta、谷歌、微软等均推出相应方法或产品。在国内,清华大学、中科大等高校同样取得显著成果。”唐家渝介绍,RealAI此前也面向公众发布了针对性的检测产品——深度伪造内容检测平台DeepReal,支持对多种深度伪造方法进行检测。该平台现已拥有工业级的检测性能和应对实网环境对抗变化的检测能力,检测准确率也达到了业内顶尖。

深度伪造内容检测平台DeepReal

防范深度伪造音视频诈骗,不仅要在技术层面研究和创新,公众防范意识也要进一步提升,形成社会合力。唐家渝提醒,深伪视频制作的原材料是个人图片、视频,这些数据越多训练出的视频也就越逼真、越难以鉴别,因此大家要注意保护好个人图像,尽量避免在公开平台大量晒自己的照片和视频。

同时,由于“AI换脸技术”肉眼无法分辨,涉及到此类钱款时,坚持“不轻信、不转账”的原则,还可追问几个只有你与借款者之间才知道的私密信息核实对方身份。此外,转账尽量使用银行账户汇款,并将转账时间设置成“24小时到账”,以便在发现被骗后,有足够的处理时间。